L’équipe RESONEO était cette année encore présente au SEO Campus. Vous avez certainement pu croiser Aymeric Bouillat et Marc San Emeterio dans la salle réservée aux cliniques SEO, Patrice Laroche, Sébastien Bulté ainsi qu’Olivier de Segonzac qui a animé la conférence sur le sujet du content marketing et de la rédaction web et SEO. Nous vous proposons un compte rendu des différentes présentations auxquelles nous avons eu le plaisir d’assister.

Les conférences :

- Les légendes urbaines du SEO

- Le « Big Data » et ses applications SEO

- Les critères constitutifs du webspam

- Optimiser sa page Facebook pour le Graph Search

- Exploiter efficacement les possibilités de Google+

- Les pénalités manuelles, algorithmiques, Panda, Penguin…

- Why you should check your backlinks in 2014 ?

- Créer des sites web mobiles « search friendly »

- Content marketing / rédaction web et SEO

- Best practices SEO pour le responsive design & lazy loading

- Piratage & SEO : Comment réagir ?

- 50 nuances de SEO sur Yandex

- Le bêtisier du SEO

- Google Now : obtenir des informations sans chercher

- Intervention de Vincent Courson (Search Quality Team de Google)

- Automatisation et SEO : Que peut-on automatiser et comment ?

- Microdonnées, Schema.org et Rich Snippets

- Challenges at Internationalization of Websites

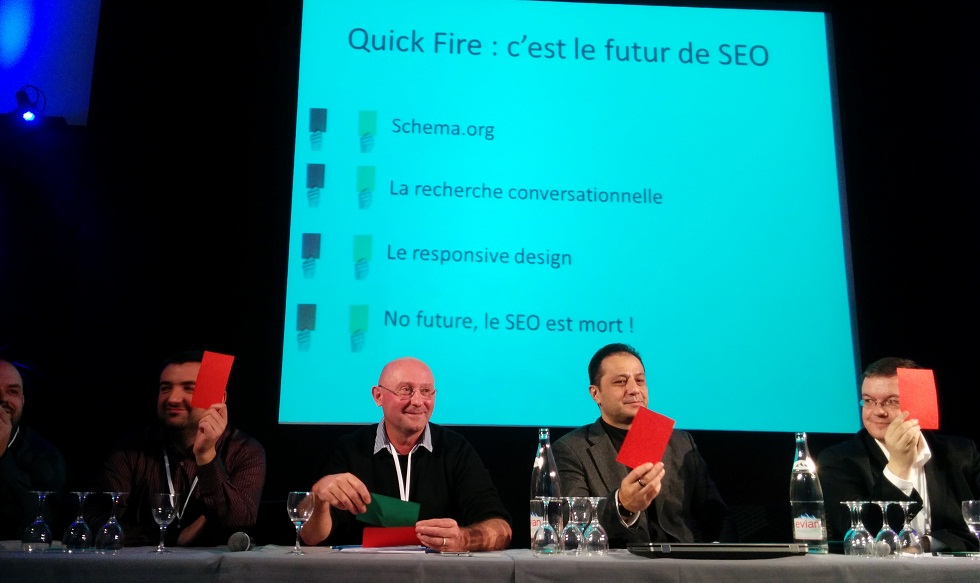

Séance « Mythbusters » : tordons le cou à quelques légendes urbaines en matière de SEO

Cette table ronde animée par Neil McCarthy nous a donné l’occasion d’avoir l’avis de Renaud Joly, Sébastien Monnier, Olivier Andrieu, Laurent Bourrelly et Philippe Yonnet sur ces mythes du SEO qui ont la vie dure. La meta Keywords est elle encore utile ? Réserver un nom de domaine pour 10 ans a-t-il un impact sur le référencent naturel ? Le taux de rebond est-il pris en compte dans les algorithmes de Google ? Adwords aide-t-il pour le SEO ? Tant de questions sur lesquelles les intervenants ont pu donner leur avis et ces derniers n’étaient pas toujours tranchés.

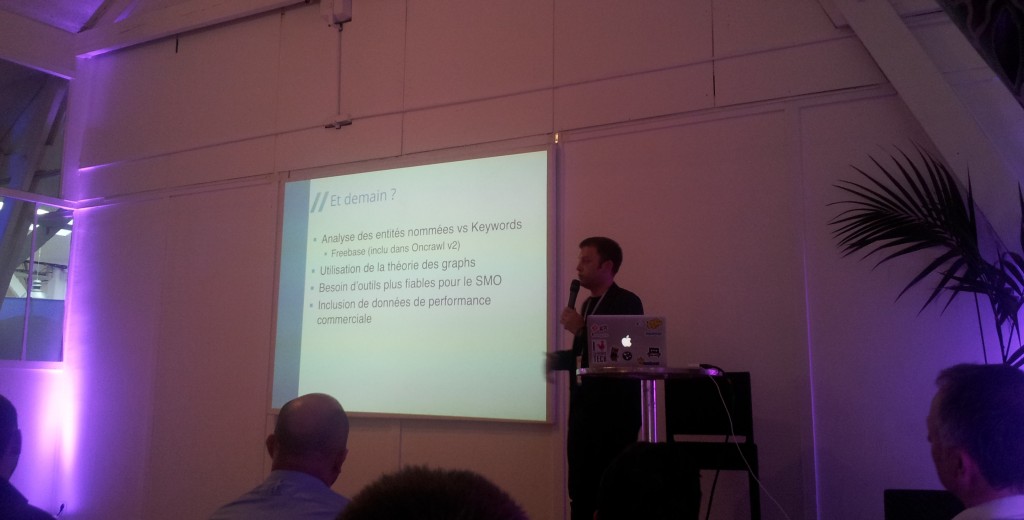

Le « Big Data » et ses applications SEO

François Goube, ambassadeur en France de Majestic SEO, est revenu sur la Big Data et ses applications pour le SEO. Nous avons aujourd’hui des technologies matures pour exploiter la Big Data parmi lesquelles Hadoop, MongoDB ou encore Elasticsearch qui sont utilisées depuis de nombreuses années par les moteurs de recherche. Ces solutions permettent le stockage et le requêtage de données en grand volume mais pas leur compréhension. Pour analyser et exploiter ces données, il est nécessaire d’avoir une intervention humaine de la part d’un statisticien par exemple. L’utilisation du big data pour le SEO est multiple : outils web analytics, analyse de logs (en utilisant conjointement Logstash et elasticsearch par exemple), analyse des liaisons entres les pages, etc.

François Goube a profité de cette tribune pour rappeler l’existence de la fonction Url submitter de Majestic SEO qui permet d’accélérer les calculs liés à une url et l’outil de crawl de sites Oncrawl (code d’invitation : SEOCAMPUS14).

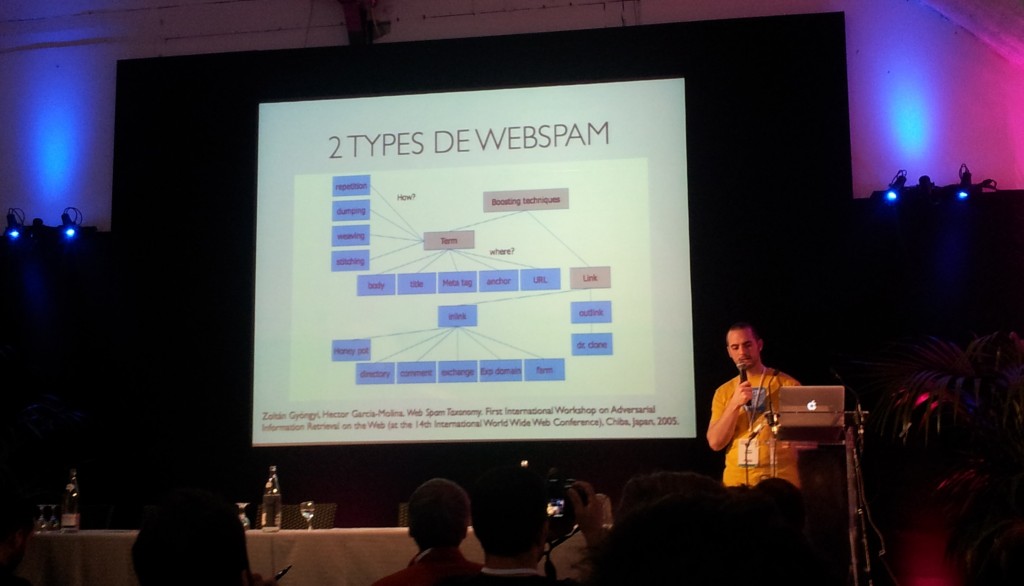

Les critères constitutifs du webspam

Sylvain et Guillaume Peyronnet sont revenus sur les critères constitutifs du webspam. Il existerait 3 types de spam : les liens népotiques (maillage entre ses propres site ou avec des sites amis), les structures d’amplification du Page Rank, le contenu spammy. La définition du spam relevant de l’intention ou d’une volonté de nuisance. Pour l’identifier et le combattre, il existe plusieurs méthodes. La première consiste à analyser le comportement des internautes (usage). La seconde concerne la mise en place de critères algorithmiques menant à un déclassement (update) ou à une suppression (filtrage). Les frères Peyronnet ont présenté des études montrant que l’on peut considérer une page comme étant spammy dès lors qu’elle s’éloigne de la norme.

Nous n’aurons pas eu de retours sur l’étude du webspam menée en crowfunding à cause de retards sur le planning, mais vous pouvez d’ores et déjà vous manifester si vous souhaitez participer à la notation des pages (spam, haute qualité, faible qualité, ne se prononce pas) ici : http://webspam.peyronnet.eu/demande.php.

La phrase à retenir : « Ce n’est pas parce qu’un critère est corrélé positivement pour le positionnement que son optimisation n’est pas considéré comme du spam ».

La présentation : http://fr.slideshare.net/freres_peyronnet/peyronnet-webspamseocampus

Optimiser sa page Facebook pour le Graph Search

La présentation de Franck Rocca sur l’exploitation de Facebook a permis de faire un bon tour d’horizon des techniques, outils et astuces pour renforcer sa stratégie de social media. Après avoir présenté les possibilités de l’outil Power Editor, Franck a présenté des case studies d’opérations réussies et une perspective ouverte sur le Graph Search de Facebook.

A retenir :

- Segmentez vos campagnes au maximum par audience, afin d’identifier plus facilement les audiences qui fonctionnent ou pas (détachez les hommes et femmes pour identifier la meilleure cible, par ex)

- Vous pouvez retargeter directement sur Facebook les visiteurs de certaines pages de votre site

- Pour accéder au Graph Search, changez la langue de l’interface en anglais. L’outil est très puissant pour récupérer les intérêts d’une population qui aime telle page et tel centre d’intérêt par exemple

- Ne pas utiliser le bouton stimuler la publication : cela pousse les pubs aux amis des fans, mais au détriment des fans directement…

- Pour faire un test A/B, il faut faire deux campagnes sinon elles se cannibalisent

- Depuis le 4 mars, Facebook a déployé ses nouvelles structures de campagnes avec désormais des « ensembles de publicités ». Le budget est attaché à l’ensemble plutôt qu’à chaque campagne

Franck a aussi expliqué comment il avait souhaité un joyeux anniversaire à sa mère via Facebook en créant une audience avec uniquement l’id de sa maman 🙂

Exploiter efficacement les possibilités de Google+

Matthieu Tournade (Yakamama) a présenté les possibilités offertes par Google+. Nous avons retenu les Ripples (ou échos) qui permettent d’avoir des informations sur les partages d’un post (exemple) et d’identifier les influenceurs. Les fonctionnalités de Hangouts, de retouche photo, de gifs animés, le partage de cercles ou les recommandations issues de ses amis Google+ affichées directement dans Gmail constituent des pistes intéressantes pour accroître la visibilité de sa marque sur ce réseau.

Mathieu a conclu en recommandant l’outil allmyplus.com pour obtenir des statistiques complètes sur son compte.

La présentation : http://www.yakamama.com/gplus

Pénalités manuelles, algorithmiques, Panda, Penguin… comment les éviter, comment en sortir ?

Cette table ronde animée par Roland Debrabant a donné lieu à de nombreux retours d’expérience de la part d’Aurélien Bardon, Sébastien Monnier et Philippe Yonnet. Il a été question de Fear, uncertainty and doubt (FUD), méthode appliquée aujourd’hui par Google. Mais aussi de secteurs particuliers tels que la mutuelle ou l’assurance : la norme en terme de limite définie par Google y est différente à cause d’un fort historique spammy et de sur-optimisation. Il fut également question de techniques pour sortir de pénalité comme aller « râler » sur les forums de Google.

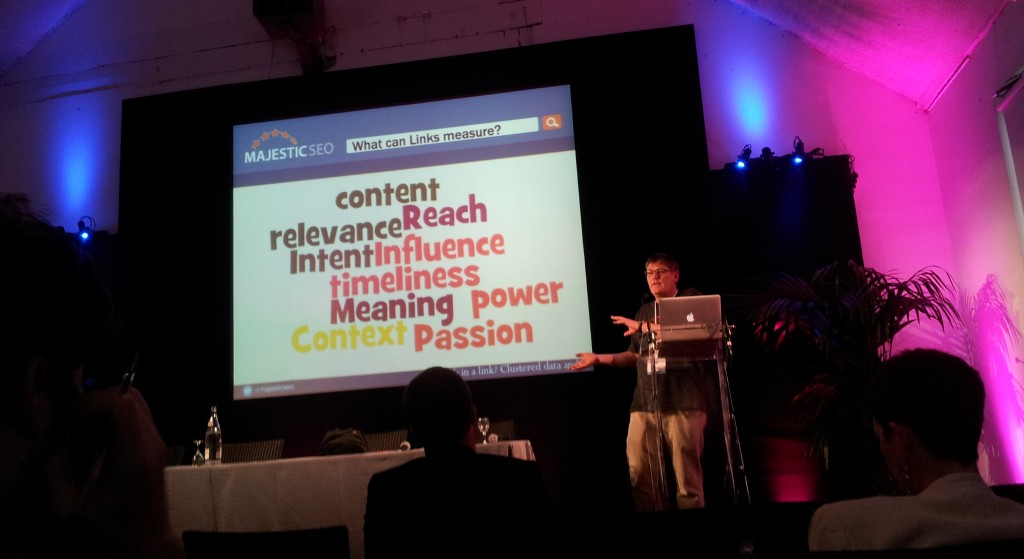

Why you should check your backlinks in 2014 ?

Dixon Jones, directeur marketing de Majestic SEO a présenté sa vision du netlinking en faisant le parallèle avec l’arbre généalogique de la famille royale britannique pour démontrer la pertinence ou non des liens tels que pourrait l’entendre Google. Avec environ 2 milliards de pages crawlées chaque jour, Majestic SEO dispose de l’une des plus grosses bases de données des liaisons entre les pages du web.

On notera que 2 études ont été régulièrement citées lors des différentes conférences : les facteurs de positionnement réalisée par Moz et celle réalisée par SearchMetrics.

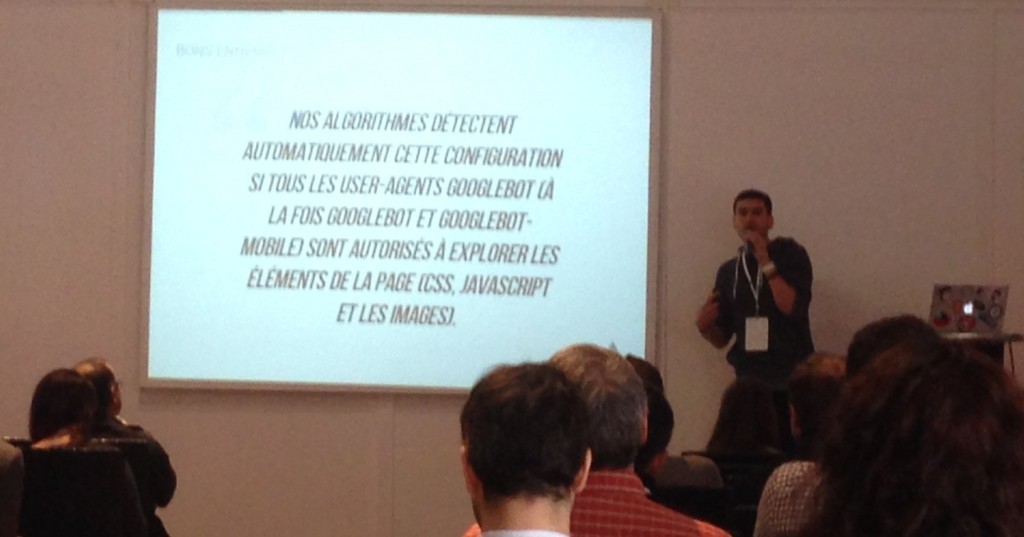

Créer des sites web mobiles « search friendly » : les recommandations de Google

Zineb Ait Bahajji (Webmaster Trends Analyst chez Google) nous a présenté les 3 méthodes d’implémentation supportées par Google pour les sites Web Mobile:

Site mobile dédié (URL différente)

• Liaison bidiretionnelle entre chaque page ayant une correspondance sur le site mobile:

Sur la page Desktop : <link rel="alternate" media="only screen and (max-width: 640px)" href="http://m.example.com/page-1">

Sur la page mobile: <link rel="canonical" href="http://www.example.com/page-1" >

Dans le cas où l’utilisateur est redirigé en fonction de son user-agent vers la version mobile, utiliser l’en-tête HTTP « Vary: User-agent ».

Dynamique Serving (même URL, contenu différent)

• Utiliser l’en-tête HTTP « Vary: User-Agent » pour indiquer à Google que le contenu servi peut être différent en fonction du User-Agent permet à Google de ne pas considérer le site comme du cloacking et d’aller crawler avec GoogleBot et Googlebot-Smartphone/Googlebot-Mobile.

Responsive web Design (même URL, même contenu)

C’est la solution recommandée par Google. Le site Web s’adapte à l’écran de l’internaute grâce aux JS/CSS et media queries. Zineb a précisé que bien que cette méthode soit recommandée par Google, les 2 autres méthodes sont très bien supportées.

Si un site mobile dédié ou un site en dynamic serving se positionne bien sur Google et est bénéfique pour l’expérience utilisateur de l’internaute, il n’est pas nécessaire de passer au Responsive. On remarquera que le site ayant servi d’exemple pendant toute la présentation était le site de Leroy Merlin (bon élève sur le SEO mobile) et ce site n’était pas en Responsive, mais en dynamic serving!

Content marketing / rédaction web et SEO

Olivier a présenté quelques règles de bon sens pour tout ceux qui souhaiteraient se lancer dans une stratégie de « content marketing » un peu avancée.

Pour résumer : le contenu peut être très efficace pour générer du ranking, mais si tout ce que vous souhaitez c’est du ranking, alors vous n’avez pas forcément besoin de contenu…

D’autant qu’animer une stratégie de contenus prend du temps, est difficile et coûte cher. Les contenus attractifs, qui génèrent des citations, et donc des liens – et donc des positions – sont généralement des contenus engagés. Il vous faudra donc avoir des idées, une opinion sur le monde qui nous entoure. Alors même si tous les business ne sont pas fait pour mettre en oeuvre une stratégie de contenus et animer une communauté, les bénéfices seront au rendez-vous pour ceux qui se lancent dans l’aventure.

La présentation :

Best practices SEO pour le responsive design & lazy loading

Matthias Dugué de Clever Age a présenté une méthode très complète sur le responsive web design (RWD) en faisant l’apologie du Lazy Loading, pas seulement pour les images mais pour touts les éléments à servir dynamiquement en fonction du device, et ce qu’on veut exclure de l’indexation comme les boutons sociaux, les maps, les lightbox, caroussels, pubs et autres contenus superflus.

Citons notamment les quelques conseils ci-dessous :

- Le RESS (Responsive Design + Server Side Components) présente les avantages du RWD en limitant ses inconvénients (webperf).

- Il est désormais possible d’adapter les interfaces à de nombreux facteurs, par exemple la luminosité ambiante

- Avec les webapp, les interfaces deviennent mouvantes. Il est nécessaire de penser l’architecture dès le démarrage du projet afin de pouvoir figer « l’application state » pour qu’à une URL corresponde un contenu (du moins pour les contenus que l’on souhaite référencer)

- Laissez tomber l’escape fragment (les hashbang dans les URL : #!) et utiliser History API à la place

- Et faire du pre rendering côté serveur : on rend les pages côté serveur, quitte à ce que ce ne soit qu’une portion et on embed le texte et images pour les crawler et users qui n’ont pas JS activé

- Dosez correctement les big menu links : si on peut lazy loader les menu c’est bien, sauf par exemple la home pour Google

- Utilisez Google Webmastrer Tools pour fetcher deux fois un même contenu avec ggbot et ggbot-mobile pour voir si on a les mêmes contenus

- Pensez la perf comme un budget autorisé et le respecter

- Faire du chargement conditionnel

- Utiliser les Data-URI

Bref, vous l’aurez compris, une presentation très technique mais à la pointe de l’état de l’art du responsive design.

Piratage & SEO : Comment réagir ?

Petite piqûre de rappel de la part de Julien Deneuville (consultant One Clic et ex-collègue de RESONEO :)) et Karim Slamani (consultant 6ix IT) en ce qui concerne les conséquences d’un piratage de site et des problèmes inhérents à son référencement. Prenant comme exemple le site France 5, les deux consultants se sont alternés pour nous décrire les différents types d’intrusion ainsi que leurs répercutions sur le site et la notoriété de la marque.Voici ce qu’il fallait retenir de leur présentation :

- En cas de piratage, le propriétaire du site est responsable de toutes les actions qui sont effectuées depuis son site.

- Surveiller les mails sortants de son serveur est un bon moyen d’identifier un piratage.

- Les pirates cherchent à identifier des empreintes (footprints) sur des CMS et logiciels connus pour exploiter leurs failles. Il est donc crucial de veiller à la bonne mise à jour de ces derniers.

Pour WordPress, par exemple, Karim recommande l’utilisation de WPScan. Selon les cas, Tripwire et Acunetix peuvent vous aider à vous protéger du piratage.

La présentation : http://www.slideshare.net/One_Clic/20140314-seocampus-piratageseopublic-32405499

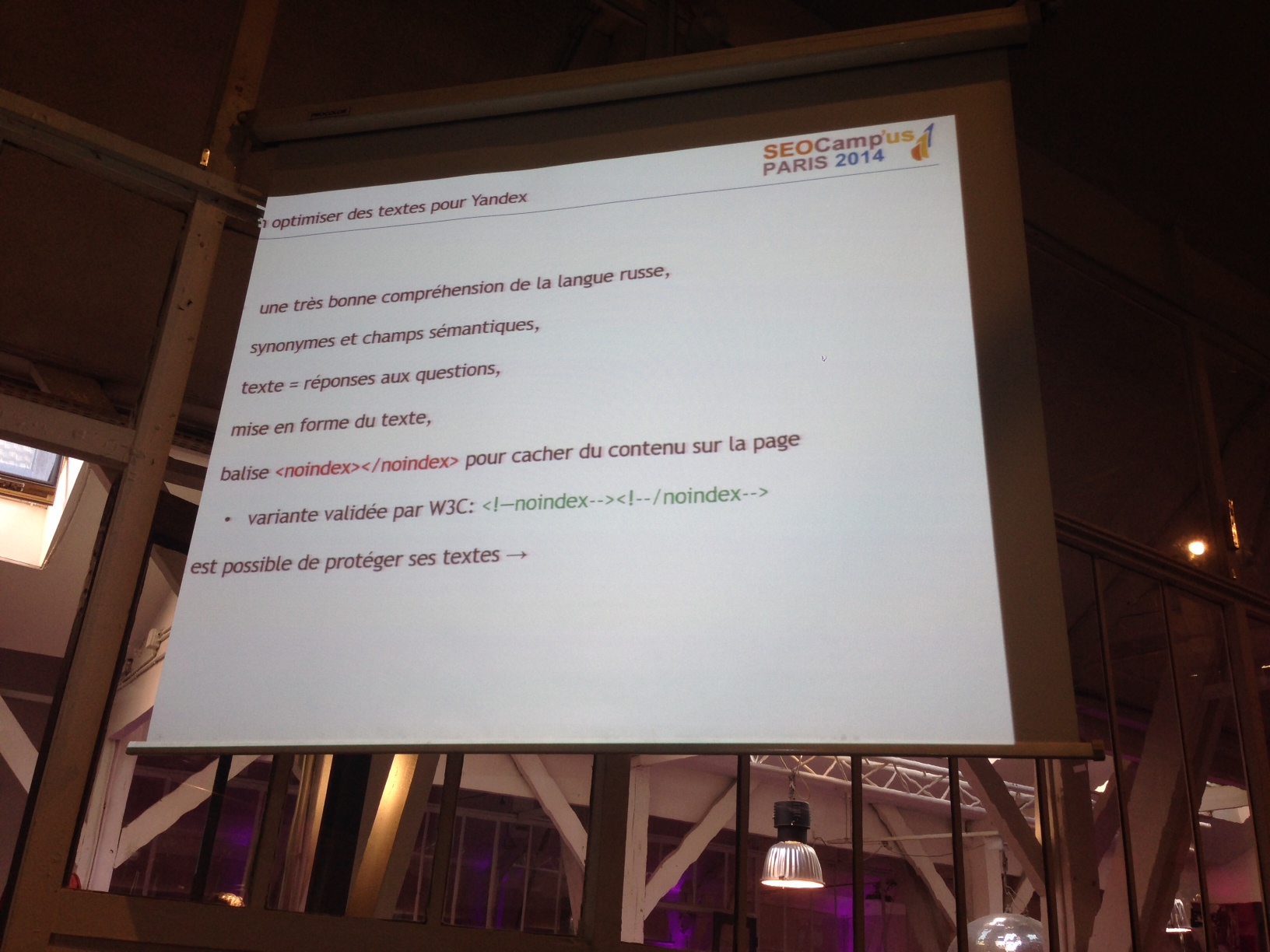

50 nuances de SEO sur Yandex

Alexis Rylko de Borovoy Studio Minsk nous a présenté les spécificités du référencement sur Yandex, dont voici quelques morceaux choisis :

- 800 facteurs de ranking dont 50 uniquement sur les liens

- Une grosse partie des résultats sont différents selon la ville liée à la requête (30%) car la Russie est un très grand pays !

- Les updates (mises a jour de l’index) se font par lot, comme Google à ses début, pas en continu. Il existe donc une Yandex Dance 🙂

- Il est nécessaire d’attribuer une région à son site, sinon pas de SEO local possible :

- Contacts et adresse sur le site

- Renseigner la localité ciblée sur l’outil Yandex pour webmasters

- Renseigner jusqu’à 7 régions sur Yandex Catalogue (attention, les modérateurs veillent…)

- Yandex interprète une balise <noindex> pour signifier au moteur de ne pas tenir compte du contenu d’une partie de la page. Utile pour les mentions légales par exemple, ou si on a du contenu spammy de type keyword stuffing (Yandex est très chatouilleux sur ce plan..)

- Yandex n’a pas attendu Google pour permettre aux éditeurs de protéger leurs contenus via un formulaire

- Une des spécificités du marché Russe : énormément d’achat de liens via Sape et Mainlink (plus de 1 million de sites en catalogue !)

- Du coup les liens achetés ne peuvent pas nuire mais peuvent être stérilisés, d’ailleurs Yandex vient d’annoncer qu’il ne tiendrait plus compte des liens pour certaines requêtes commerciales

- A noter que Yandex avait déjà pénalisé des sites utilisant l’achat de liens par le passé. Ses SERP étant devenues trop spammy après cette pénalité, Yandex était revenu en arrière…

- Comme Google, Yandex déploie aussi ses propres filtres pour lutter contre les sites montés pour vendre des liens. Le dernier porte le doux nom de AGS-40 – à l’instar du lance-grenades russe…

- Mais Yandex sait aussi se rendre sympatique aux yeux des webmasters en leur proposant de nouveaux outils utiles dans sa console dédiée, comme le Webvisor, un Clicktale-like entièrement gratuit.

La présentation : http://fr.slideshare.net/AlexisRylko/50-nuances-de-seo-sur-yandex-seocampus-2014-paris

Le bêtisier du SEO

Paul Sanches et Simon Gardette sont revenus de manière humoristique sur quelques anecdotes savoureuses du milieu SEO. Il a été question, dans le désordre et de manière non exhaustive, de :

- Concours de référencement

- Professeur Bukkake

- Marabout SEO

- Matt Cutts et la Dark SEO Team

- Google Boost Rank

- Les couteaux de Jack Dutrong

- La Cnil

Une présentation très rafraîchissante avec de nombreuses interactions et animations 🙂

Google Now : obtenir des informations sans chercher

Laurent Bourrelly a donné son point de vue sur le futur de Google en présentant les fonctionnalités de Google Now qui se basent sur la recherche prédictive. Votre smartphone qui vous suit partout vous apporte des réponses contextualisées en fonction de votre intérêt, du moment présent et du lieu dans lequel vous vous situez par le biais de « cartes », les Google Now Cards : cartes d’embarquement, mesure de l’activité sportive, calcul d’itinéraire, et bien d’autres demain.

Laurent a mis l’accent sur ce que l’on peut attendre de Google dans les années à venir en mettant en avant les Google X Labs, un regroupement de philosophes, chercheurs, artistes, écrivains, etc. dont on peut voir un aperçu ici : Solveforx.com. Le souhait de Google, qui se profile déjà avec les Google Glass ou avec les Google Cars, est d’améliorer l’humain avec les conséquences sur notre quotidien que l’on peut imaginer.

Intervention de Vincent Courson (Search Quality Team de Google)

Vincent Courson, membre de l’équipe de qualité de Google a mis en avant le souhait de Google de mieux communiquer auprès des webmasters que ce soit par le biais de vidéos comme le Hangout dédié aux demandes de réexamens, par la lecture des discussions postées sur les forums pour webmasters ou encore par la proposition de nouvelles fonctions dans les Webmaster Tools. A cette occasion, un nouveau blog en français pour les webmasters a été mis en ligne : http://googlewebmastercentral-fr.blogspot.fr/.

Automatisation et SEO : Que peut-on automatiser et comment ?

Pour construire des réseaux de sites jetables, il est possible d’automatiser de nombreuses actions. Paul Sanches a remplacé Rudy Som au pied levé pour présenter ces actions automatisables : achat de noms de domaines, installation de sites, production de contenu et génération de liens. Parmi les outils présentés, nous avons retenu : InternetBS pour acheter des domaines et cacher le whois, AdopteUnDomaine ou Pool.com pour repérer des domaines expirés, Scrapebox pour scraper des données, Sick Submitter pour générer des liens en masse et Piwik pour suivre l’évolution du trafic des sites.

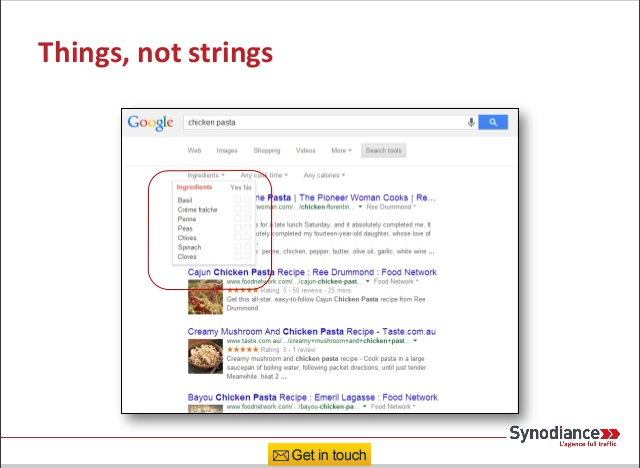

Microdonnées, Schema.org et Rich Snippets

Yann Sauvageon, directeur associé de Synodiance, a démontré l’intérêt des données enrichies pour les moteurs de recherche. Partant du constat que les robots des moteurs de recherche ne sont pas capables de déterminer la nature de l’information, Google, Yahoo et Bing se sont mis d’accord sur une syntaxe permettant de définir celle-ci : schema.org. On estime à l’heure actuelle que 15% des pages ont intégrés schema.org. Ce format devient de plus en plus important car il est pris en compte pour le Knowledge Graph, Google answer Box/Card sans oublier les moteurs verticaux comme dans l’exemple ci-dessous :

Il n’est pas nécessaire d’entreprendre de grand chantier pour la mise en place des schema.org. Il est possible d’utiliser Google Data Highlighter dans un premier temps et de vérifier la prise en compte de ceux-ci dans Google Webmaster Tools.

La présentation : http://www.slideshare.net/Synodiance/synodiance-microdata-schemaorg-rich-snippets-seo-campus-2014-13032014

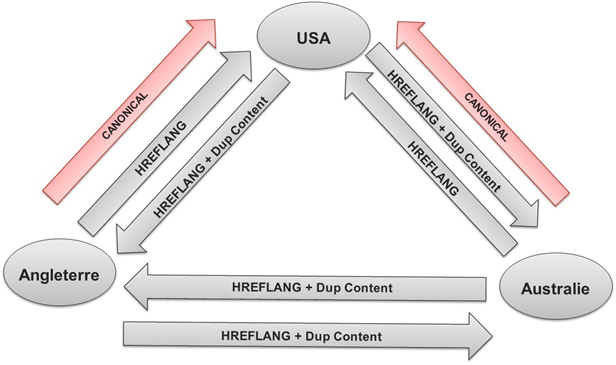

Challenges at Internationalization of Websites

L’allemand André Alpar est venu présenter les différentes problématiques liées à la mise en place d’un site international. L’utilisation d’une même langue pour des pays différents est souvent facteur de duplication voir de « squating » de position par le site du mauvais pays. Pour pallier à ce problème, il préconise l’utilisation des balises hreflang associées à des balises canonical.

Une étude faite par son agence recommande l’utilisation de TLD plutôt que des sous-domaines ou sous-répertoires pour l’implémentation d’un site multilingue. En effet, sur le long terme, les deux dernières solutions perdent en puissance d’indexation selon lui.

D’autres présentations à découvrir

– 10 stratégies de netlinking à tester en 2014

– La réussite d’une mission SEO

– Making the Most out of your Local SEO

– Étude sur les référenceurs en France

– Réussir une refonte de site sans perdre son référencement

– Attirez dès à présent vos clients via facebook

– Analyse combinée crawl + logs

Notre seul regret : ne pas avoir pu assister à l’ensemble des conférences tant le programme était étoffé cette année ! Et un souhait pour l’avenir : que le SEO Campus soit au rendez-vous en 2015 🙂